Kaggle - APTOS 2019 Blindness Detection 대회

농촌 지역에서 수집 된 수천 장의 이미지를 사용하여 당뇨병 성 망막증을 자동으로 식별 할 수 있습니다.

공하면 평생 실명을 예방하는 데 도움이 될뿐만 아니라이 모델을 사용하여 녹내장 및 황반 변성과 같은 다른 종류의 질병을 발견 할 수도 있습니다.

출하려면 커널을 통해 제출해야합

모델을 오프라인으로 훈련시키고 데이터 세트로 업로드 한 다음 커널을 독점적으로 사용하여 추론을 수행 할 수 있습니

- CPU 또는 GPU 커널 <= 9 시간 런타임

- 인터넷이 꺼져 있어야합니다

ㅁ 대회 소개

전문가들은 신흥, 혁신적인 디지털 기술은 안과 치료를 향상시키기 위해 세계의 다른 부분에 사용하는 방법을 공유합니다. 올해 회의의 주제는 AI의 진화, 검증 및 지속 가능성입니다. 2016 년 APTOS 심포지엄에서 AI가 얼마나 발전했는지 살펴보고이 흥미로운 분야에서 다음 단계가 무엇인지 살펴 보겠습니다. 이 경쟁의 목표는 전 세계에서 알고리즘을 캡처하고 새로운 데이터 과학자를 양성하는 것입니다.

ㅁ 평가 함수

두 명의 측정자 (rater) 의 일치도를 평가 (inter-rater agreement) 할 때 쓰이며, 측정치가 순서가 있는 정성적 지표 (ordinal categorical variable) 일 때 쓰인다.계 학습에서는 알고리즘 예측과 동일한 객체의 신뢰할 수있는 레이블 사이의 일치 정도를 수량화하는 데 사용할 수 있습니다

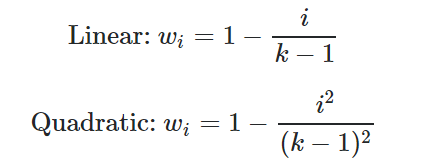

However, this is not the case for quadratic weights, where penalties begin mild then grow harsher

linear와 quadratic 차이

출처: https://3months.tistory.com/404 [Deep Play]

the quadratic weighted kappa

https://3months.tistory.com/404

Linearly weighted kappa

https://www.kaggle.com/aroraaman/quadratic-kappa-metric-explained-in-5-simple-steps

0 - No DR

1 - Mild

2 - Moderate

3 - Severe

4 - Proliferative DR

The Kappa coefficient is a chance-adjusted index of agreement. In machine learning it can be used to quantify the amount of agreement between an algorithm's predictions and some trusted labels of the same objects. Kappa starts with accuracy - the proportion of all objects that both the algorithm and the trusted labels assigned to the same category or class. However, it then attempts to adjust for the probability of the algorithm and trusted labels assigning items to the same category "by chance." It does this by assuming that the algorithm and the trusted labels each have a predetermined quota for the proportion of objects to assign to each category. The original kappa coefficient assumed nominal categories but this was later extended to non-nominal categories through "weighting." The idea behind weighting is that some categories are more similar than others and thus some mismatching pairs of categories deserve varying degrees of "partial credit." Quadratic weights are one popular way of determining how much partial credit to assign to each mismatched pair of categories; there are other weights. I have more information about all of these concepts, including MATLAB functions, o

'Kaggle 대회' 카테고리의 다른 글

| [Porto Seguro’s Safe Driver Prediction] 데이터 탐색하기 (0) | 2020.02.02 |

|---|---|

| [Porto Seguro’s Safe Driver Prediction] 대회 소개 / 지니계수 란? (0) | 2020.02.02 |

| [Santander Product Recommendation] 전혀 다른 모델 활용하기(MLP) (0) | 2019.12.25 |

| [Santander Product Recommendation] Feature engineering (0) | 2019.12.25 |

| [Santander Product Recommendation] Baseline 구축하기② (0) | 2019.12.25 |

댓글